Was ist ein DeepCrawl?

Die Fähigkeit eines Suchmaschinen Crawlers eigenständig Unterseiten einer Website zu durchsuchen, deren Content zu bewerten und indexieren, wird als DeepCrawl (dt: Tiefen-Indexierung) bezeichnet.

DeepCrawl in einem Video erklärt

In diesem Video erklären wir den Begriff „DeepCrawl“

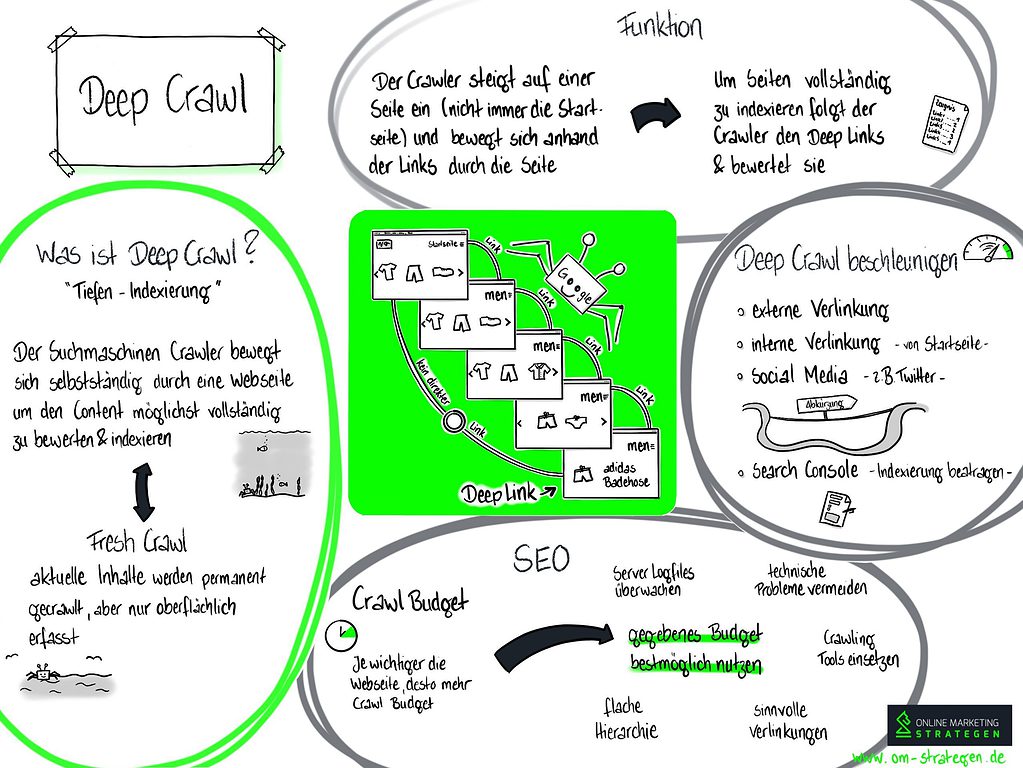

Infografik zum DeepCrawl

Infografik zum Google DeepCrawl

Wie funktioniert der DeepCrawl?

Große Websites werden von Suchmaschinen nicht bei jedem Besuch vollständig gecrawlt, auch findet der Einstieg des Webcrawlers nicht immer von der Startseite statt. Der Crawler folgt den Verlinkungen der Websites und arbeitet sich so von Seite zu Seite vor. Sogenannte Deep Links sind Unterseiten, welche nicht direkt von der Startseite aus erreichbar sind. Solche Unterseiten können beispielsweise Produkt-Detailseiten sein. Stellen wir uns eine Hierarchie eines Shops für Mode vor:

Ebene 1: Startseite

Ebene 2: Herrenmode

Ebene 3: Bekleidung

Ebene 4: Badehosen

Ebene 5: Das Produkt, z.B. die Adidas Badeshort

Da das Produkt, im Beispiel Ebene 5, nicht direkt von der Startseite verlinkt ist, folgt der Crawler den jeweiligen Kategorien, sofern er den Einstieg über die Startseite findet:

Startseite → Herrenmode → Bekleidung → Badehosen → Produkt

Ein anderes Beispiel kann auch sein, dass dieses Produkt über einen Markenbereich verlinkt ist:

Startseite → Marken → Adidas → Produkt

Es gibt unterschiedliche Einstiegspunkte und Verweise innerhalb der Website.

Ziel des DeepCrawl

Durch das Verfolgen der Deep Links ist das klare Ziel des Crawlers die Website oder den Online Shop vollumfänglich zu indexieren und auf deren Inhalte zu bewerten. Letztendlich entscheidet dann der Algorithmus die Ausspielung der gefundenen URL zur passenden Suchanfrage sowie der Einordnung im Ranking.

Wie den DeepCrawl beschleunigen?

Sie möchten die Indexierung einer Unterseite beschleunigen, so haben Sie hierzu verschiedene Möglichkeiten eine Unterseite schneller in den Index der Suchmaschinen zu bekommen:

- externe Verlinkungen: Durch eine externe Verlinkung, gezielt auf die Unterseite, stoßen Sie die Indexierung dieser an. Der Bot folgt dem externen Link und indexiert somit Ihre Site

- interne Verlinkungen: Handelt es sich um ein wichtiges Produkt, so hilft auch eine Verlinkung aus einer der oberen Ebenen, d.h. Startseite, Kategorie oder Unterkategorie. Das Highlighten eines Produkts, im Onlineshop, führt ebenfalls zur schnelleren Indexierung.

- Social Media: Die Erwähnung in Social Media, insbesondere Twitter, kann ebenfalls zu einer schnellen Indexierung führen. Wichtig ist, dass der Account auch wiederum von Suchmaschinen erfasst werden kann.

- Search Console: Über die Google Search Console haben Sie die Möglichkeit eine Indexierung zu beantragen, dies ist nur limitiert möglich.

Welche Rolle spielt das Crawl Budget?

Das Crawl Verhalten der Google Bots hängt von verschiedenen Faktoren ab. Je wichtiger Google eine Website einstuft, desto häufiger und tiefer wird diese gecrawlt. Ausgehend vom Google PageRank-Gedanken, werden Websites eingestuft und mit einem entsprechenden Crawl Budget versehen. Der Hintergedanke ist hierbei, dass auch Google keine unlimitierten Ressourcen in Form von Rechenkapazitäten besitzt und diese so sinnvoll wie möglich versucht einzusetzen. Häufige Probleme im Crawling sind technischer Natur, sei es z.B. fehlerhafte Canonical Tag, Duplicate Content oder Ladezeiten, die den Crawler irgendwann zum Abbrechen bewegen. Es ist daher wichtig, mittels flacher Hierarchie der Website-Struktur und sinnvollen internen Verlinkungen, den Crawler entsprechend zu steuern. Websites mit wenigen tausend URLs haben in der Regel kein Problem mit dem Crawl Budget.

Unterschied zum Fresh Crawl

Wohingegen der DeepCrawl versucht bestmöglich die Website vollumfänglich zu indexieren, ist Ziel des Fresh Crawl aktuelle Inhalte im Internet zu finden und demnach permanent zu crawlen. Die Inhalte werden nur oberflächlich erfasst und auf Änderungen geprüft. Die Häufigkeit des Fresh Crawlings hängt von dem Trust der Domain (die Marke) oder aber vom Intervall der Aktualisierung ab.

Fazit

Für die Suchmaschinenoptimierung (SEO) ist das Thema DeepCrawl ein wichtiger Bestandteil für die technische Optimierung. Der SEO setzt hier auf eine flache Website-Struktur, interne Verlinkungen, Vermeidung von z.B. Duplicate Content, langen Ladezeiten usw., um das Crawl Budget optimal zu nutzen. Bei größeren Websites oder OnlineShops werden auch Server Logfiles überwacht, oder spezielle Crawling-Tools eingesetzt, die das Optimum in der SEO herausholen.

Weiterführende Links

Crawl Budget aus Google Bot Sicht: https://webmasters.googleblog.com/2017/01/what-crawl-budget-means-for-googlebot.html